Парсинг данных. Сбор и обработка данных - парсинг

Представим такую ситуацию: вы пришли в библиотеку и нашли десятки книг по интересующей ваc теме и хотите разместить их тексты на своем сайте. Вам придется потратить много времени, чтобы отсканировать содержимое страниц и привести их в подходящий формат. А вот если бы можно было одним нажатием кнопки сделать все сразу?

Или такой пример: вы наши интересный сайт с рецептами и хотите скопировать рецепты на свой сайт. Это было бы просто, если страниц всего 2-3, а если тысячи? Как автоматизировать этот процесс, чтобы не потерять время? В этом случае, вам поможет парсинг.

Так что же такое парсинг?

Парсинг – это синтаксический анализ сайтов, производящийся парсером- специальной программой или скриптом. Собранная информация представляется в определенном виде, по определенным правилам, алгоритмам и проводится на одном из языков программирования. Только анализ и сбор информации происходит не из книг, а только с интернет-ресурсов.

Объектом парсинга может быть справочник, интернет-магазин, форум, блог и абсолютно любой интернет-ресурс.

Зачем нужен парсинг?

Особенность парсинга в том, что в отличие от человека, автоматическая программа:

- Быстро обработает необъятное количество страниц

- Отделит все типы информации и отберет все самое нужное

- Упакует результаты в заданном определенном виде

Однако если информация зашита в Flash ролике, спарсить ее не удастся.

Как происходит процесс парсинга?

Любой процесс парсинга состоит из следующих фрагментов:

- Скачивание кода страниц, из которых извлекаются необходимые данные. Самым распространенным способом для получения кода является библиотека cURL для языка PHP

- Анализ полученной информации. На этом этапе извлекают необходимую информацию из всей полученной. Для этой цели используют регулярные выражения.

- Обработка и преобразование данных. В рамках данного фрагмента процесса преобразовывают данные в необходимый формат.

- Генерация результата и его вывод в файл или на экран – завершающий этап парсинга.

Результатом парсинга может быть текстовый файл, файл Эксель, csv, HTML файл, каталог с картинками, видео или любой другой формат по желанию.

Парсинг сайтов – это самый лучший способ автоматизировать процесс сбора и сохранения информации. Благодаря парсеру можно создавать и обновлять сайты, схожие по оформлению, содержанию и структуре.

Что такое парсинг? Что обозначает это слово, какой процесс под этим подразумевается. У многих новичков при встрече с незнакомыми терминами возникают примерно такие, вполне естественные вопросы.

Мне самому, когда впервые столкнулся с этим термином стало интересно, что же там эти оптимизаторы и вебдизайнеры парсят время от времени. итак перейдем к определению этого термина.

Термин « Парсинг» обозначает проведение визуального или программно-автоматизированного синтаксического и лексического анализа или разбора какого-либо документа с целью извлечения из него необходимых данных.

Это понятие очень близко по значению еще одного не очень понятного человеку далекому от SEO индустрии –

.

Также этот термин близок по смыслу таким понятиям как анализ и аудит.

В применении к SEO, парсинг это сбор информации с какого-то веб-ресурса. Парсить – значит разбирать какой-либо документ на составляющие части и обрабатывать их, согласно конечной цели.

Парсинг данных

Получается, что все процессы, где применяется синтаксический анализ, используют парсинг. Это различные автоматизированные переводчики с одного языка на другой, это и трансляторы языков программирования, которые формируют программный код на машинно-ориентированный язык, это и язык SQL-запросов и тому подобные процессы.

Как нетрудно понять, парсят в подавляющем большинстве случаев при помощи какой-либо программы, так как вручную или визуально это проделывать достаточно трудоемко. Эти программы называют парсерами.

Запросы на услуги парсинга популярны на фриланс-биржах или форумах, посвященных тематике SEO.

Парсинг сайтов

Какие же данные чаще всего получают при помощи парсинга? Это, например, подборка статей определенного автора, или подбор данных на определенную тематику.

Также для анализа часто парсят:

- Выдачу поисковых систем

- Поисковые запросы, семантику

- Информацию по сайтам конкурентов (CMS, структуру, СЯ,…)

- Данные с медиа-ресурсов, различных форумов

- Данных с интернет-магазинов — товаров, цен и т.п.

- И еще много самых различных данных

Это процесс называют парсингом сайтов.

Процесс парсинга в общем случае можно разделить на три этапа:

- Анализ исходных данных, отбор документов для дальнейшей обработки.

- Разбор отобранных документов на составляющие части, выбор необходимой информации и сохранение данных в необходимом формате.

- Систематизация и формирование данных в формате, отчета, таблицы или другого понятного документа.

Приведу простой пример. Например, есть сайт-каталог промышленных компаний. Обработав этот сайт при помощи парсера, можно получить данные в виде отчета или таблицы примерно такого формата:

В СЕО-продвижении парсинг чаще всего используют для получения контента для дальнейшего рерайта или репостинга или для поиска каких-либо веб-ресурсов — форумов, блогов, Email-адресов. Также популярен парсинг внешних ссылок , для анализа сайтов-конкурентов и обнаружения доступных трастовых сайтов.

Давайте на простом примере разберем что такое парсинг. Представьте, что Вы пришли в библиотеку и хотите быстро переписать все статьи из большой советской энциклопедии и разместить их у себя на сайте. И вот Вы сидите дни на пролет и изучаете каждый том, каждую статью, ищете информацию. А что если бы одним нажатием кнопки кто то за Вас сделал всю эту работу?

Или другой пример, более приближенный к реальности. Вы нашли интересный сайт с рецептами и хотите быстро и полностью скопировать их на свой сайт. Это не проблема, когда страниц всего несколько, но что если их тысячи или даже сотни тысяч? Как автоматизировать процесс, что бы не потерять время?

Это и есть процесс парсинг, только анализ и сбор информации происходит не из книг, а исключительно с интернет ресурсов. Процесс парсинга выполняется специальной программой-парсером. Она действует по определенным правилам и алгоритмам, которые закладывает разработчик. Например, можно собрать все статьи из википедии или получить телефоны с сайта объявлений авито и это лишь ничтожно малая часть возможностей парсинга. Объектом парсинга может быть блог, справочник, интернет-магазин, форум да и любой сайт который можно увидеть в интернете. Конечно, есть исключения, например когда вся инфомрация зашита во Flash ролике, то спарсить ее не получится. В любом случае перед парсингом требуется изучить ресурс-донор.

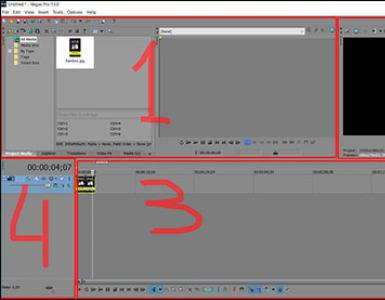

Парсер предоставляет информацию в определенном виде, который так же задается разработчиком программы. Весь процесс интернет парсинга можно разделить на несколько этапов:

- Получение кода интернет страницы

- Анализ полученных данных

- Обработка и формирование результата

- Вывод результата в файл или на экран

Результатом парсинга может быть текстовый файл, файл Эксель, csv, HTML файлы, каталог с картинками или видео и любой другой формат по требованию.

Для быстрой обработки информации применяется парсинг. Так называют последовательный синтаксический анализ информации, размещенной на веб-страницах. Этот метод используется для оперативной обработки и копирования большого количества данных, если ручная работа требует много времени.

Для этого используются парсеры - специальные программы, способные анализировать контент в автоматическом режиме и находить нужные фрагменты.

Зачем нужен парсинг и парсеры?

Для создания сайта и его требуется большое количество контента, который необходимо долго создавать в ручном режиме.

Парсеры обладают следующими возможностями:

- Обновление информации для поддержки актуальности. Отслеживать изменения курса валют или прогноза погоды в ручном режиме нереально, поэтому прибегают к парсингу.

- Сбор и быстрое копирование информации с других сайтов для размещения на собственном ресурсе. Данные, полученные с помощью парсинга, подвергают . Такое решение используется для заполнения киносайтов, новостных проектов, ресурсов с кулинарными рецептами и прочих площадок.

- Соединение потоков данных. Проводится сбор большого количества данных с нескольких источников, обработка и размещение. Это удобно для заполнения новостных площадок.

Парсинг существенно ускоряет процесс работы с ключевыми словами. Настроив работу, возможно оперативно подобрать необходимые для продвижения запросы. После кластеризации по страницам подготавливается SEO-контент, в котором будет учтено максимум ключей.

Особенности работы парсера

Парсеры пишутся на любом языке программирования (PHP, C++, Delphi и других), где присутствует поддержка регулярных выражений. Это набор метасимволов, используемых для поиска необходимых данных.

Парсер за короткий срок обходит тысячи страниц, фильтрует представленные данные, отбирая среди них нужные, после чего пакует полученный результат для последующей обработки.

Привет, ребят. Опережая события, хочу предупредить, что для того, чтобы парсить сайты необходимо владеть хотя бы php. У меня есть интересная статья о том, . И все же, что такое парсинг?

Начнем с определения. В этой статье речь пойдет о парсинге сайтов. Попробую объяснить как можно проще и доходчивее.

Парсинг, что это значит: слово понятное дело пришло от английского parse -по факту это означает разбор содержимого страницы на отдельные составляющие. Этот процесс происходит автоматически благодаря специальным программам (парсеров).

В пример парсера можно привести поисковые системы. Их роботы буквально считывают информацию с сайтов, хранят данные об их содержимом в своих базах и когда вы вбиваете поисковой запрос они выдают самые подходящие и актуальные сайты.

Кстати говоря, если вы планируете сделать мощное приложение, которое могло бы работать удаленно, то вам может понадобиться аренда dedicated сервера . Это отличный способ получить достаточно мощные ресурсы и нужное количество памяти.

Парсинг? Зачем он нужен?

Представьте себе, что вы , не , а крупный портал с множеством страниц. У Вас есть красивый дизайн, панель управления и возможно даже разделы, которые вы хотите видеть, но где взять информацию для наполнения сайта?

В интернете – где ж еще. Однако не все так просто.

Приведу в пример лишь 2 проблемы при наполнении сайта контентом:

- Серьезный объём информации. Если Вы хотите обойти конкурентов, хотите чтобы Ваш ресурс был популярен и успешен, Вам просто необходимо публиковать огромное количество информации на своем ресурсе. Сегодняшняя тенденция показывает, что контента нужно больше чем возможно заполнить вручную .

- Постоянные обновления. Информацию которая все время меняется и которой как мы уже сказали большие объемы, невозможно обновлять вовремя и обслуживать. Некоторые типы информации меняются ежеминутно и обновлять её руками невозможно и не имеет смысла.

Это самое оптимальное решение, чтобы автоматизировать процесс изменения и сбора контента.

Чем парсинг круче работы человека:

- быстро изучит тысячи сайтов;

- аккуратно отделит нужную информацию от программного кода;

- безошибочно выберет самые сливки и выкинет ненужное;

- эффективно сохранит конечный результат в нужном виде.

Как парсить сайты?

Тут я буду краток, скажу лишь, что для этого можно использовать практически любой язык программированию, который мы используем при разработке сайтов. Это и php, и C++, и python и т.д.

Поскольку наиболее распространенным среди веб-разработчиков является php, я собираюсь написать подробную инструкцию, как можно можно парсить сайты при помощи php или специальных сервисов.

Что такое парсер сайта

Парсер – это скрипт, который вытягивает нужную информацию со сторонних ресурсов.

Парсером может быть как онлайн сервис, так и программное обеспечение, которое устанавливается на компьютер.

Например, я пользовался такой программой, когда нужно было быстро наполнить интернет магазин в 10 000 товаров. Вручную я бы занимался этим целый год наверное. А так справился за неделю.

При установке такого ПО скорость работы во многом зависит от производительности вашего компа. Чем мощнее, тем быстрее происходит процесс обработки данных.

В другом случае, я воспользовался онлайн сервисом, который автоматически брал новости с одного сайта(когда они появлялись) и вставлял их на сайт клиента. Хотя на SEO продвижение такой подход влияет отрицательно. Но, как говорится, желание клиента закон.

Заказать парсинг для сайта/интернет-магазина

Если вам срочно понадобилось настроить парсинг статей на сайт или спарсить товары в магазин, можете оставить заявку и мои программисты за отдельную плату помогут решить эту задачу