Big data определение. Почему Big Data постоянно путают с маркетингом и ИТ

По материалам research&trends

Big Data, «Большие данные» вот уже несколько лет как стали притчей во языцех в IT-и маркетинговой прессе. И понятно: цифровые технологии пронизали жизнь современного человека, «все пишется». Объем данных о самых разных сторонах жизни растет, и одновременно растут возможности хранения информации.

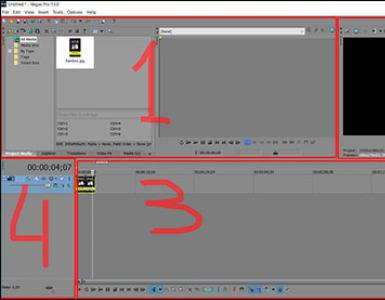

Глобальные технологии для хранения информации

Источник: Hilbert and Lopez, `The world"s technological capacity to store, communicate, and compute information,`Science, 2011 Global.

Большинство экспертов сходятся во мнении, что ускорение роста объема данных является объективной реальностью. Социальные сети, мобильные устройства, данные с измерительных устройств, бизнес-информация – вот лишь несколько видов источников, способных генерировать гигантские объемы информации. По данным исследования IDC Digital Universe , опубликованного в 2012 году, ближайшие 8 лет количество данных в мире достигнет 40 Зб (zettabytes) что эквивалентно 5200 Гб на каждого жителя планеты.

Рост собираемой цифровой информации в США

Источник: IDC

Значительную часть информации создают не люди, а роботы, взаимодействующие как друг с другом, так и с другими сетями данных – такие, как, например, сенсоры и интеллектуальные устройства. При таких темпах роста количество данных в мире, по прогнозам исследователей, будет ежегодно удваиваться. Количество виртуальных и физических серверов в мире вырастет десятикратно за счет расширения и создания новых data-центров. В связи с этим растет потребность в эффективном использовании и монетизации этих данных. Поскольку использование Big Data в бизнесе требует немалых инвестиций, то надо ясно понимать ситуацию. А она, в сущности, проста: повысить эффективность бизнеса можно сокращая расходы или/и увеличивая объем продаж.

Для чего нужны Big Data

Парадигма Big Data определяет три основных типа задач.

- Хранение и управление объемом данных в сотни терабайт или петабайт, которые обычные реляционные базы данных не позволяют эффективно использовать.

- Организация неструктурированной информации, состоящей из текстов, изображений, видео и других типов данных.

- Анализ Big Data, который ставит вопрос о способах работы с неструктурированной информацией, генерацию аналитических отчетов, а также внедрение прогностических моделей.

Рынок проектов Big Data пересекается с рынком бизнес-аналитики (BA), объем которого в мире, по оценкам экспертов, в 2012 году составил около 100 млрд. долларов. Он включает в себя компоненты сетевых технологий, серверов, программного обеспечения и технических услуг.

Также использование технологий Big Data актуально для решений класса гарантирования доходов (RA), предназначенных для автоматизации деятельности компаний. Современные системы гарантирования доходов включают в себя инструменты обнаружения несоответствий и углубленного анализа данных, позволяющие своевременно обнаружить возможные потери, либо искажение информации, способные привести к снижению финансовых результатов. На этом фоне российские компании, подтверждающие наличие спроса технологий Big Data на отечественном рынке, отмечают, что факторами, которые стимулируют развитие Big Data в России, являются рост данных, ускорение принятия управленческих решений и повышение их качества.

Что мешает работать с Big Data

Сегодня анализируется только 0,5% накопленных цифровых данных, несмотря на то, что объективно существуют общеотраслевые задачи, которые можно было бы решить с помощью аналитических решений класса Big Data. Развитые IT-рынки уже имеют результаты, по которым можно оценить ожидания, связанные с накоплением и обработкой больших данных.

Одним из главных факторов, который тормозит внедрение Big Data - проектов, помимо высокой стоимости, считается проблема выбора обрабатываемых данных : то есть определение того, какие данные необходимо извлекать, хранить и анализировать, а какие – не принимать во внимание.

Многие представители бизнеса отмечают, что сложности при внедрении Big Data-проектов связаны с нехваткой специалистов – маркетологов и аналитиков. От качества работы сотрудников, занимающихся глубинной и предикативной аналитикой, напрямую зависит скорость возврата инвестиций в Big Data. Огромный потенциал уже существующих в организации данных часто не может быть эффективно использован самими маркетологами из-за устаревших бизнес-процессов или внутренних регламентов. Поэтому часто проекты Big Data воспринимаются бизнесом как сложные не только в реализации, но и в оценке результатов: ценности собранных данных. Специфика работы с данными требует от маркетологов и аналитиков переключения внимания с технологий и создания отчетов на решение конкретных бизнес-задач.

В связи с большим объемом и высокой скоростью потока данных, процесс их сбора предполагает процедуры ETL в режиме реального времени. Для справки: ETL – от англ. Extract , Transform , Load - дословно «извлечение, преобразование, загрузка») - один из основных процессов в управлении хранилищами данных, который включает в себя: извлечение данных из внешних источников, их трансформацию и очистку с целью соответствия нуждам ETL следует рассматривать не только как процесс переноса данных из одного приложения в другое, но и как инструмент подготовки данных к анализу.

И тогда вопросы обеспечения безопасности данных, поступающих из внешних источников, должны иметь решения, соответствующие объемам собираемой информации. Так как методы анализа Big Data развиваются пока только вслед за ростом объема данных, большую роль играет свойство аналитических платформ использовать новые методы подготовки и агрегирования данных. Это говорит о том, что, например, данные о потенциальных покупателях или массивное хранилище данных с историей кликов на сайтах online-магазинов могут быть интересны для решения разных задач.

Трудности не останавливают

Несмотря на все сложности с внедрением Big Data, бизнес намерен увеличивать вложения в это направление. Как следует из данных Gartner , в 2013 году 64% крупнейших мировых компаний уже инвестировали, либо имеют планы инвестировать в развертывание технологий в области Big Data для своего бизнеса, тогда, как в 2012 году таких было 58%. По данным исследования Gartner, лидерами инвестирующих в Big Data отраслей являются медиа компании, телеком, банковский сектор и сервисные компании. Успешные результаты внедрения Big Data уже достигнуты многими крупными игроками в сфере розничной торговли в части использования данных, полученных с помощью инструментов радиочастотной идентификации, систем логистики и репленишмента (от англ. replenishment - накопление, пополнение – R&T), а также из программ лояльности. Удачный опыт ритейла стимулирует другие отрасли рынка находить новые эффективные способы монетизации больших данных, чтобы превратить их анализ в ресурс, работающий на развитие бизнеса. Благодаря этому, по прогнозам экспертов, в период до 2020 года инвестиции в управление, хранение снизятся на каждый гигабайт данных с 2$ до 0,2$, а вот на изучение и анализ технологических свойств Big Data вырастут всего на 40%.

Расходы, представленные в различных инвестиционных проектах в области Big Data, имеют разный характер. Статьи затрат зависят от видов продуктов, которые выбираются, исходя из определенных решений. Наибольшая часть затрат в инвестиционных проектах, по мнению специалистов, приходится на продукты, связанные со сбором, структурированием данных, очисткой и управлением информацией.

Как это делается

Существует множество комбинаций программного и аппаратного обеспечения, которые позволяют создавать эффективные решения Big Data для различных бизнес дисциплин: от социальных медиа и мобильных приложений, до интеллектуального анализа и визуализации коммерческих данных. Важное достоинство Big Data – это совместимость новых инструментов с широко используемыми в бизнесе базами данных, что особенно важно при работе с кросс-дисциплинарными проектами, например, такими как организация мульти-канальных продаж и поддержки покупателей.

Последовательность работы с Big Data состоит из сбора данных, структурирования полученной информации с помощью отчетов и дашбордов (dashboard), создания инсайтов и контекстов, а также формулирования рекомендаций к действию. Так как работа с Big Data подразумевает большие затраты на сбор данных, результат обработки которых заранее неизвестен, основной задачей является четкое понимание, для чего нужны данные, а не то, как много их есть в наличии. В этом случае сбор данных превращается в процесс получения исключительно нужной для решения конкретных задач информации.

Например, у телекоммуникационных провайдеров агрегируется огромное количество данных, в том числе о геолокации, которые постоянно пополняются. Эта информация может представлять коммерческий интерес для рекламных агентств, которые могут использовать ее для показа таргетированной и локальной рекламы, а также для ритейлеров и банков. Подобные данные могут сыграть важную роль при решении открытия торговой точки в определенной локации на основе данных о наличии мощного целевого потока людей. Есть пример измерения эффективности рекламы на outdoor-щитах в Лондоне. Сейчас охват подобной рекламы можно измерить лишь поставив возле рекламных конструкций людей со специальным устройством, подсчитывающим прохожих. По сравнению с таким видом измерения эффективности рекламы, у мобильного оператора куда больше возможностей – он точно знает местонахождение своих абонентов, ему известны их демографические характеристики, пол, возраст, семейное положение, и т.д.

На основе таких данных, в будущем открывается перспектива менять содержание рекламного сообщения, используя предпочтения конкретного человека, проходящего мимо рекламного щита. Если данные показывают, что проходящий мимо человек много путешествует, то ему можно будет показать рекламу курорта. Организаторы футбольного матча могут оценить количество болельщиков только когда те придут на матч. Но если бы они имели возможность запросить у оператора сотовой связи информацию, где посетители находились за час, день или месяц до матча, то это дало бы организаторам возможность планировать места для размещения рекламы следующих матчей.

Другой пример – как банки могут использовать Big Data для предотвращения мошенничества. Если клиент заявляет об утере карты, а при совершении покупки с ее помощью банк видит в режиме реального времени месторасположение телефона клиента в зоне покупки, где происходит транзакция, банк может проверить информацию по заявлению клиента, не пытался ли он обмануть его. Либо противоположная ситуация, когда клиент совершает покупку в магазине, банк видит, что карта, по которой происходит транзакция, и телефон клиента находятся в одном месте, банк может сделать вывод, что картой пользуется ее владелец. Благодаря подобным преимуществам Big Data, расширяются границы, которыми наделены традиционные хранилища данных.

Для успешного принятия решения о внедрении решений Big Data компании необходимо рассчитать инвестиционный кейс и это вызывает большие трудности из-за множества неизвестных составляющих. Парадоксом аналитики в подобных случаях становится прогнозирование будущего на основе прошлого, данные о котором зачастую отсутствуют. В этом случае важным фактором является четкое планирование своих первоначальных действий:

- Во-первых, необходимо определить одну конкретную задачу бизнеса, для решения которой будут использоваться технологии Big Data, эта задача станет стержнем определения верности выбранной концепции. Необходимо сосредоточиться на сборе данных, связанных именно с этой задачей, а в ходе проверки концепции вы сможете использовать различные инструменты, процессы и методы управления, которые позволят принимать более обоснованные решения в будущем.

- Во-вторых, маловероятно, что компания без навыков и опыта аналитики данных сможет успешно реализовать проект Big Data. Необходимые знания всегда вытекают из предыдущего опыта аналитики, что является основным фактором, влияющим на качество работы с данными. Важную роль играет культура использования данных, так как часто анализ информации открывает суровую правду о бизнесе, и чтобы принять эту правду и работать с ней, необходимы выработанные методы работы с данными.

- В третьих, ценность технологий Big Data заключается в предоставлении инсайтов Хорошие аналитики остаются дефицитом на рынке. Ими принято называть специалистов, имеющих глубокое понимание коммерческого смысла данных и знающих, как правильно их применять. Анализ данных является средством для достижения целей бизнеса, и чтобы понять ценность Big Data, необходима соответствующая модель поведения и понимание своих действий. В этом случае большие данные дадут массу полезной информации о потребителях, на основе которой можно принять полезные для бизнеса решения.

Несмотря на то, что российский рынок Big Data только начинает формироваться, отдельные проекты в этой области уже реализуются достаточно успешно. Некоторые из них успешны в области сбора данных как, например, проекты для ФНС и банка «Тинькофф Кредитные Системы», другие - в части анализа данных и практического применения его результатов: это проект Synqera.

В банке «Тинькофф Кредитные Системы» был реализован проект по внедрению платформы EMC2 Greenplum, которая является инструментом для массивно-параллельных вычислений. В течение последних лет у банка выросли требования к скорости обработки накопленной информации и анализа данных в режиме реального времени, вызванные высокими темпами роста количества пользователей кредитных карт. Банк объявил о планах расширения использования технологий Big Data, в частности для обработки неструктурированных данных и работы с корпоративной информацией, получаемой из разных источников.

В ФНС России в настоящий момент идет создание аналитического слоя федерального хранилища данных. На его основе создается единое информационное пространство и технология доступа к налоговым данным для статистической и аналитической обработки. В ходе реализации проекта выполняются работы по централизации аналитической информации с более чем 1200 источниками местного уровня ИФНС.

Еще одним интересным примером анализа больших данных в режиме реального времени является российский стартап Synqera, который разработал платформу Simplate. Решение основано на обработке больших массивов данных, программа анализирует информацию о покупателях, историю их покупок, возраст, пол и даже настроение. На кассах в сети косметических магазинов были установлены сенсорные экраны с датчиками, распознающими эмоции покупателей. Программа определяет настроение человека, анализирует информацию о нем, определяет время суток и сканирует базу скидок магазина, после чего отправляет покупателю таргетированные сообщения об акциях и специальных предложениях. Это решение повышает покупательскую лояльность и увеличивает продажи ритейлеров.

Если говорить об иностранных успешных кейсах, то в этом плане интересен опыт применения технологий Big Data в компании Dunkin`Donuts, использующей данные в режиме реального времени для продажи продукции. Цифровые дисплеи в магазинах отображают предложения, сменяющие друг друга каждую минуту, в зависимости от времени суток и наличия продукции. По кассовым чекам компания получает данные, какие именно предложения получили наибольший отклик у покупателей. Данный подход обработки данных позволил увеличить прибыль и оборачиваемость товаров на складе.

Как показывает опыт внедрения Big Data-проектов, эта область призвана успешно решать современные бизнес-задачи. При этом важным фактором достижения коммерческих целей при работе с большими данными является выбор правильной стратегии, которая включает в себя аналитику, выявляющую запросы потребителей, а также использование инновационных технологий в области Big Data.

По данным глобального опроса, ежегодно проводимого Econsultancy и Adobe с 2012 года среди маркетологов компаний, «большие данные», характеризующие действия людей в Интернете, могут многое. Они способны оптимизировать оффлайновые бизнес-процессы, помочь понять как владельцы мобильных девайсов пользуются ими для поиска информации или просто «сделать маркетинг лучше», т.е. эффективнее. Причем, последняя функция год от года все популярнее, как это следует из приведенной нами диаграммы.

Основные области работы интернет-маркетологов с точки зрения отношений с покупателями

Источник

: Econsultancy and Adobe, опубликовано

– emarketer.com

Заметим, что национальность респондентов большого значения не имеет. Как показывает опрос, проведенный KPMG в 2013 году, доля «оптимистов», т.е. тех, кто использует Big Data при разработке бизнес-стратегии, составляет 56%, причем, колебания от региона к региону невелики: от 63% в североамериканских странах до 50% в EMEA.

Использование Big Data в различных регионах мира

Источник

: KPMG, опубликовано

– emarketer.com

Между тем, отношение маркетологов к подобным «модным трендам» в чем-то напоминает известный анекдот:

Скажи, Вано, ты помидоры любишь?

- Поесть люблю, а так – нет.

Несмотря на то, что маркетологи на словах «любят» Big Data и вроде бы даже их используют, на самом деле, «все сложно», как пишут о своих сердечных привязанностях в соцсетях.

По данным опроса, проведенного компанией Circle Research в январе 2014 года среди европейских маркетологов, 4 из 5 опрошенных не используют Big Data (при том, что они их, конечно, «любят»). Причины разные. Закоренелых скептиков немного – 17% и ровно столько же, сколько и их антиподов, т.е. тех, кто уверенно отвечает: «Да». Остальные – это колеблющиеся и сомневающиеся, «болото». Они уходят от прямого ответа под благовидными предлогами в духе того, что «пока нет, но скоро» или «подождем, пока остальные начнут».

Использование Big Data маркетологами, Европа, январь 2014

Источник:

dnx,

опубликовано –

emarketer.

com

Что же их смущает? Сущие пустяки. Некоторые (их ровно половина) попросту не верят этим данным. Другие (их тоже немало – 55%) затрудняются в соотнесении между собой множеств «данных» и «пользователей». У кого-то просто (выразимся политкорректно) внутрикорпоративный беспорядок: данные бесхозно гуляют между маркетинговыми отделами и IT структурами. У других софт не справляется с наплывом работы. И так далее. Поскольку суммарные доли существенно превышают 100%, понятно, что ситуация «множественных барьеров» встречается нередко.

Барьеры, препятствующие использованию Big Data в маркетинге

Источник:

dnx,

опубликовано –

emarketer.

com

Таким образом, приходится констатировать, что пока «Большие данные» - это большой потенциал, которым еще надо суметь воспользоваться. Кстати говоря, именно это может быть и стало причиной того, что Big Data утрачивают ореол «модного тренда», как об этом свидетельствуют данные опроса, проведенного уже упомянутой нами компании Econsultancy.

Самые значимые тренды в диджитал-маркетинге 2013-2014

Источник

: Econsultancy and Adobe

На смену им выходит другой король – контент-маркетинг. Надолго ли?

Нельзя сказать, что Большие Данные – это какое-то принципиально новое явление. Большие источники данных существуют уже много лет: базы данных по покупкам клиентов, кредитным историям, образу жизни. И в течение многих лет ученые использовали эти данные, чтобы помогать компаниям оценивать риск и прогнозировать будущие потребности клиентов. Однако сегодня ситуация изменилась в двух аспектах:

Появились более сложные инструменты и методы для анализа и сочетания различных наборов данных;

Эти аналитические инструменты дополнены целой лавиной новых источников данных, вызванной переходом на цифровые технологии практически всех методов сбора и измерения данных.

Диапазон доступной информации одновременно и вдохновляет, и пугает исследователей, выросших в структурированной исследовательской среде. Потребительские настроения фиксируются сайтами и всевозможными разновидностями социальных медиа. Факт просмотра рекламы фиксируется не только телевизионными приставками, но и с помощью цифровых тегов и мобильных устройств, общающихся с телевизором.

Поведенческие данные (такие как число звонков, покупательские привычки и покупки) теперь доступны в режиме реального времени. Таким образом, многое из того, что раньше можно было получить с помощью исследований, сегодня можно узнать с помощью источников больших данных. И все эти информационные активы генерируются постоянно, независимо от каких бы то ни было исследовательских процессов. Эти изменения и заставляют нас задаться вопросом: смогут ли большие данные заменить собой классические исследования рынка.

Дело не в данных, дело в вопросах и ответах

Прежде чем заказывать похоронный звон по классическим исследованиям, мы должны напомнить себе, что решающее значение имеет не наличие тех или иных активов данных, а нечто иное. Что именно? Наша способность отвечать на вопросы, вот что. У нового мира больших данных есть одна забавная черта: результаты, полученные на основе новых информационных активов, приводят к появлению еще большего количества вопросов, а на эти вопросы, как правило, лучше всего отвечают традиционные исследования. Таким образом, по мере роста больших данных мы видим параллельный рост наличия и потребности в «маленьких данных» (small data), которые могут дать ответы на вопросы из мира больших данных.

Рассмотрим ситуацию: крупный рекламодатель проводит постоянный мониторинг трафика в магазинах и объемов продаж в режиме реального времени. Существующие исследовательские методики (в рамках которых мы опрашиваем участников исследовательских панелей об их мотивациях к покупке и поведении в точках продаж) помогают нам лучше нацелиться на определенные сегменты покупателей. Эти методики могут быть расширены – они могут включать в себя более широкий диапазон активов больших данных вплоть до того, что большие данные становятся средством пассивного наблюдения, а исследования – методом постоянного узкоцелевого исследования изменений или событий, требующих изучения. Именно так большие данные могут освободить исследования от лишней рутины. Первичные исследования уже не должны фокусироваться на том, что происходит (это сделают большие данные). Вместо этого первичные исследования могут сосредоточиться на объяснении того, почему мы наблюдаем те или иные тенденции или отклонения от тенденций. Исследователь сможет меньше думать о получении данных, и больше – о том, как их проанализировать и использовать.

В то же время мы видим, что большие данные позволяют решать одну из наших самых больших проблем – проблему чрезмерно длинных исследований. Изучение самих исследований показало, что чрезмерно раздутые исследовательские инструменты оказывают негативное воздействие на качество данных. Хотя многие специалисты в течение длительного времени признавали наличие этой проблемы, они неизменно отвечали на это фразой: «Но ведь эта информация нужна мне для высшего руководства», и длинные опросы продолжались.

В мире больших данных, где количественные показатели можно получить с помощью пассивного наблюдения, этот вопрос становится спорным. Опять же, давайте вспомним обо всех этих исследованиях, касающихся потребления. Если большие данные дают нам инсайты о потреблении с помощью пассивного наблюдения, то первичным исследованиям в форме опросов уже не надо собирать такого рода информацию, и мы сможем, наконец, подкрепить свое видение коротких опросов не только благими пожеланиями, но и чем-то реальным.

Big Data нуждаются в вашей помощи

Наконец, «большие» - это лишь одна из характеристик больших данных. Характеристика «большие» относится к размеру и масштабу данных. Конечно, это основная характеристика, поскольку объем этих данных выходит за рамки всего того, с чем мы работали прежде. Но другие характеристики этих новых потоков данных также важны: они зачастую плохо форматированы, неструктурированны (или, в лучшем случае, структурированы частично) и полны неопределенности. Развивающаяся область управления данными, метко названная «анализ сущностей» (entity analytics), призвана решить проблему преодоления шума в больших данных. Ее задача – проанализировать эти наборы данных и выяснить, сколько наблюдений относится к одному и тому же человеку, какие наблюдения являются текущими, и какие из них – пригодны для использования.

Такой вид очистки данных необходим для того, чтобы удалить шум или ошибочные данные при работе с активами больших или небольших данных, но этого недостаточно. Мы также должны создать контекст вокруг активов больших данных на основе нашего предыдущего опыта, аналитики и знания категории. На самом деле, многие аналитики указывают на способность управлять неопределенностью, присущей большим данным, как источник конкурентного преимущества, так как она позволяет принимать более эффективные решения.

И вот тут-то первичные исследования не только оказываются освобожденными от рутины благодаря большим данным, но и вносят свой вклад в создание контента и анализ в рамках больших данных.

Ярким примером этого может служить приложение нашей новой принципиально иной рамочной модели капитала бренда к социальным медиа (речь идет о разработанном в Millward Brown новом подходе к измерению ценности бренда The Meaningfully Different Framework – «Парадигма значимых отличий » - R & T ). Эта модель проверена на поведении в рамках конкретных рынков, реализована на стандартной основе, и ее легко применить в других маркетинговых направлениях и информационных системах для поддержки принятия решений. Другими словами, наша модель капитала бренда, опирающаяся на исследования методом опросов (хотя и не только на них) обладает всеми свойствами, необходимыми для преодоления неструктурированного, несвязного и неопределенного характера больших данных.

Рассмотрим данные по потребительским настроениям, предоставляемые социальными медиа. В сыром виде пики и спады потребительских настроений очень часто минимально коррелируют с параметрами капитала бренда и поведения, полученными в оффлайне: в данных просто слишком много шума. Но мы можем уменьшить этот шум, применяя наши модели потребительского смысла, дифференциации брендов, динамики и отличительных черт к сырым данным потребительских настроений – это способ обработки и агрегации данных социальных медиа по этим измерениям.

После того, как данные организованы в соответствии с нашей рамочной моделью, выявленные тренды обычно совпадают с параметрами капитала бренда и поведения, полученными в оффлайне. По сути, данные социальных медиа не могут говорить сами за себя. Чтобы использовать их для указанной цели требуется наш опыт и модели, выстроенные вокруг брендов. Когда социальные медиа дают нам уникальную информацию, выраженную на том языке, который потребители используют для описания брендов, мы должны использовать этот язык при создании своих исследований, чтобы сделать первичные исследования гораздо более эффективными.

Преимущества освобожденных исследований

Это возвращает нас к тому, что большие данные не столько заменяют исследования, сколько освобождают их. Исследователи будут освобождены от необходимости создавать новое исследование по каждому новому случаю. Постоянно растущие активы больших данных могут быть использованы для разных тем исследований, что позволяет последующим первичным исследованиям углубиться в тему и заполнить имеющиеся пробелы. Исследователи будут освобождены от необходимости полагаться на чрезмерно раздутые опросы. Вместо этого они смогут использовать краткие опросы и сосредоточиться на самых важных параметрах, что повышает качество данных.

Благодаря такому освобождению исследователи смогут использовать свои отработанные принципы и идеи, чтобы добавить точности и смысла активам больших данных, что приведет к появлению новых областей для исследований методом опроса. Этот цикл должен привести к более глубокому пониманию по целому ряду стратегических вопросов и, в конечном счете, к движению в сторону того, что всегда должно быть нашей главной целью - информировать и улучшать качество решений, касающихся бренда и коммуникаций.

16.07.18. Mail.ru запустила Big Data as a Service

Облачная платформа Mail.ru пополнилась сервисом для анализа больших данных Cloud Big Data , который базируется на фреймворках Apache Hadoop и Spark. Сервис будет полезен ритейлерам, финансовым организациям, которым нужно анализировать большие данные, но которые не хотят тратить много денег на собственные сервера. Mail.ru берет деньги только за фактическое время работы оборудования. Так, кластер Hadoop из 10 узлов обойдется клиенту в 39 руб. за один час работы. Напомним, в прошлом году МТС запустил такой же BigData-сервис Cloud МТС . Стоимость использования сервиса составляла от 5 тыс. руб. в месяц. Также, услуги по обработке больших данных предоставляет .

2017. МТС запустила облачную платформу для обработки Big Data

Оператор МТС запустил услугу по облачной обработке больших данных для бизнеса в рамках своей облачной платформы #CloudМТС . Компании смогут работать с данными в программных средах Hadoop и Spark. Например, этот облачный сервис поможет бизнесу таргетировать рекламу, собирать и обрабатывать открытые данные, проводить финансовую и бизнес-аналитику. Интернет-магазины смогут анализировать поведение клиентов, а затем предлагать готовые таргетированные предложения к разным событиям и праздникам. Сервис работает при помощи предустановленных инструментов расчета, однако есть возможность создать собственные алгоритмы обработки данных. Стоимость использования сервиса составляет от 5 тысяч рублей в месяц, цена изменяется в зависимости от пространства, занятого в облаке. Напомним, платформа #CloudМТС была создана в 2016 году. Сначала она предоставляла только услуги облачного хранения данных, а позже появилась и услуга облачных вычислений.

2016. Big Data прогноз на Олимпиаду в Рио

Уже скоро Big Data сервисы будут подсказывать вам, какие решения принимать для роста и обеспечения безопасности вашего бизнеса. Пока же они, в основном, тренируются на спортивных мероприятиях. Помните, недавно интеллектуальная платформа Microsoft спрогнозировала результаты Чемпионата Европы по футболу? Так вот, нифига она не угадала. На этот раз американская компания Gracenote, которая специализируется на обработке больших данных, просчитала наиболее вероятный вариант медального зачета Олимпиады в Рио. На картинке - прогноз, который был составлен за месяц до Олимпиады. Он постоянно обновляется. Текущая версия - .

2016. Интеллектуальная платформа Microsoft спрогнозировала результаты Чемпионата Европы по футболу

У Microsoft (как у любого уважающего себя ИТ-гиганта) уже есть аналитическая платформа, основанная на обработке больших данных (Big Data) и искусственном интеллекте - Microsoft Cortana Intelligence Suite . На основании различных данных из ваших бизнес-систем, она может предсказать отток клиентов, поломки оборудования, изменение доходов и т.д. А сейчас, Microsoft дает нам возможность проверить, насколько точно работает эта платформа. Проанализировав футбольную историю, статистическую информацию о командах, результативности игроков, полученных травмах, а также комментарии фанатов в социальных сетях, она представила свой прогноз на Чемпионат Европы по футболу, который стартует сегодня. Итак, согласно прогнозу: в финале Германия победит Испанию с вероятностью 66%. А в стартовом матче Франция выиграет у Румынии с вероятностью 71%.

2016. SAP и Яндекс создают Big Data сервис для удержания клиентов

2 года назад Яндекс запустил сервис , который предоставляет услуги обработки больших данных для бизнесов. Этот сервис уже помог таким компаниям как Билайн и Wargaming (Word of Tanks) избегать оттока клиентов. Он предсказывает периоды оттока на основании исторических данных и дает бизнесу возможность подготовиться и вовремя предложить какую-нибудь новую акцию. Теперь, видимо, эта технология Яндекс заинтересовала крупнейшего в мире игрока на корпоративном ИТ рынке - компанию SAP. Компании объединили усилия, чтобы разработать сервис для предсказания поведения клиентов. По мнению SAP и YDF, сервис будут использовать в ритейле, e-commerce, банках и телекоммуникациях. Говорят, сервис будет предназначен для среднего бизнеса, в том числе, и по цене.

2016. PROMT Analyser - морфологический анализатор Big Data

Компания PROMT выпустила PROMT Analyser - решение в области искусственного интеллекта для работы с большими данными в информационно-аналитических системах. Инструмент предназначен для поиска, извлечения, обобщения и структуризации информации из практически любого текстового контента на разных языках как в корпоративных системах, так и во внешних источниках. Он анализирует любые тексты или документы, выделяет в них сущности (персоналии, организации, географические названия, геополитические сущности и др.), а также определяет соотносящиеся с этим сущностями действия, дату и место совершения действия, формирует целостный образ документа. PROMT Analyser позволяет решать самые разные задачи: анализ внутренних ресурсов компании (системы документооборота), анализ внешних ресурсов (медиа, блогосфера и пр.), анализ данных, получаемых из закрытых источников, для оценки критичности ситуаций, анализ деятельности объекта с привязкой к географии, а также оптимизация поисковых систем и служб поддержки.

2016. Mail.Ru поможет компаниям анализировать их данные

Mail.Ru стремится ни в чем не отставать от своего главного конкурента - Яндекса. Год назад Яндекс сервис анализа больших данных для бизнеса. А теперь Mail.ru открыла Big Data направление для корпоративных клиентов. Прежде всего, оно будет заниматься проектами, направленными на повышение эффективности процессов маркетинга и продаж, оптимизации производства, логистики, управления рисками, планирования, управления персоналом и другие рабочие процессы различных бизнесов. Например, Mail.ru сможет создать модель прогнозирования оттока клиентов, отклика на предложения, прогноз реакции на обращение через определенный канал коммуникации. Это позволит сделать взаимодействие с потенциальным клиентом более персонифицированным. В Mail.ru заявляют, что компания занимается анализом данных фактически с момента основания и имеет собственные технологии машинного обучения.

2015. IBM станет ведущим провайдером прогноза погоды для бизнеса

Важна ли погода для бизнеса? Конечно, особенно, если ваш бизнес - это сельхоз предприятие, турфирма, кафе или магазин одежды. Погода влияет на стабильность поставок, выбор ассортимента и активность продаж. В таком случае, каждая уважающая себя система бизнес-аналитики должна учитывать прогноз погоды. Так подумали в IBM и купили крупнейшую в мире метеослужбу The Weather Company. IBM планирует скормить данные из трех миллиардов прогнозных референсных точек своему суперкомпьютеру Watson и совершить переворот в прогнозировании погоды. Кроме того, они планируют создать платформу, которая позволит сторонним бизнес-приложениям использовать информацию о погоде за некоторую плату.

2015. Видео: как использовать Big Data для привлечения талантливых сотрудников

Вы все еще сомневаетесь, что Big Data - это полезно для бизнеса? Тогда посмотрите этот ролик о том, как Билайн привлекает новых талантливых работников с помощью Big Data. В начале сентября по Москве курсировало такое Big Data Taxi в виде автомобиля Tesla. По словам представителя Билайн, кроме помощи в привлечении новых талантов, технологии Big Data позволяют компании решать самые разные задачи. Начиная от таких простых и тривиальных, как «найди всех

тех, кто пользуется SIM, купленной по чужому паспорту», и заканчивая -

«определи возраст абонента по совокупности показателей».

2015. Microsoft представила говорящую Big Data платформу

Технологии Big Data обещают компаниям волшебную оптимизацию бизнес процессов, например: у вас всегда будет нужное количество товара в нужном месте, в нужное время. Но те компании, которые уже попробовали Big Data говорят: на практике это не работает. Существующие Big Data системы предназначены для аналитиков, а обычному сотруднику, который должен принять решение здесь и сейчас, они не помогают. Поэтому, в Microsoft решили выпустить Big Data платформу с человеческим лицом (точнее - голосом) - Cortana Analytics Suite . Она основана на облачной платформе Azure и использует голосового помощника Cortana в качестве интерфейса. Предполагается, что с помощью визуального конструктора любой начальник департамента сможет создавать мини-приложения, обрабатывающие большие объемы данных, а любой сотрудник - сможет спрашивать у Кортаны и получать нужную информацию в нужное время, в нужном месте.

2015. Видео: Что такое Big Data и кому это нужно?

Российский стартап CleverData позиционируется как Big Data-интегратор. Они реализуют проекты для решения конкретных бизнес-задач с использованием Big Data платформ и технологий. На видео генеральный директор CleverData Денис Афанасьев интересно рассказывает о том, что такое Big Data и откуда эти большие данные появились. Оказывается, технологии обработки больших данных существуют уже не один десяток лет, но причина появления маркетингового термина Big Data в том, что (благодаря облачным вычислениям) снизилась их стоимость, и они стали доступными малым-средним компаниям. По словам Дениса, чаще всего Big Data применяется для маркетинга (сегментация клиентской базой, онлайн реклама), ит безопасности (выявление мошенничества, прогнозирование поломок), риск менеджмента (оценка кредитоспособности клиентов).

2015. SAP представил Next Big Thing - ERP-систему S/4HANA

Первая ERP система SAP называлась R/2 и работала на мейнфреймах. Потом был R/3. В 2004 году появился SAP Business Suite. На днях SAP представил (как они говорят) самый главный продукт в своей истории - новую версию S4/HANA . При ее создании разработчики думали не о том, как утереть нос извечному конкуренту Oracle, а о том, как не дать себя обставить агрессивным SaaS-провайдерам Salesforce и Workday. Поэтому S4 сможет работать как локально, так и в облаке. Главная фишка системы - скорость. Как следует из названия, в основе S4 лежит ведущая Big-Data платформа SAP HANA, которая позволяет обрабатывать очень большие данные за секунды. Вторая главная фишка - интерфейс. Забудьте о сложных таблицах и меню, в которых без бутылки не разобраться. SAP хочет, чтобы новой мощной системой можно было управлять с помощью смартфона. Для работы с SAP можно будет использовать как минимум 25 простых приложений SAP Fiori. Вот их видеопрезентация:

2014. Яндекс открыл Big Data сервис для бизнеса

Яндекс запустил проект Yandex Data Factory , который будет предоставлять услуги обработки больших данных для бизнесов. Для этого он использует технологию машинного обучения Матрикснет, которую Яндекс разработал для ранжирования сайтов в своей поисковой системе. Заявляется, что Яндекс планирует стать конкурентом таким компаниям, как SAP AG и Microsoft. На данный момент специалисты Yandex Data Factory реализовали несколько пилотных проектов с европейскими компаниями. В частности искусственный интеллект Яндекса использовался компанией, обслуживающей линии электропередач, для прогнозирования поломок, банком - для таргетирования заемщиков, автодорожным агентством для прогнозирования пробок на дорогах. Кроме того, оказывается Яндекс обрабатывает данные, полученные из знаменитого адронного коллайдера в центре CERN.

2014. Microsoft поможет Мадридскому Реалу выигрывать с помощью Big Data

От добра добра не ищут. Мадридский Реал довольно хорошо играет в последнее время и добивается высоких результатов. Однако, лавры сборной Германии, выигравшей чемпионат мира с помощью не дают покоя президенту мадридского клуба Флорентино Пересу (крайний слева на фото). Поэтому он заключил контракт с Microsoft на сумму $30 млн, в рамках которого будет создана современная ИТ инфраструктура клуба. Тренерский состав и игроки Реала получат планшеты Surface Pro 3 с

предустановленными приложениями Office 365 для более тесного взаимодействия

персонала. А используя аналитические инструменты Power BI for Office 365, тренеры команды

смогут изучать эффективность игры футболистов, определять долгосрочные

тенденции и даже предсказывать травмы.

2014. 1С-Битрикс запустил сервис Big Data

Big Data - технологии для обработки очень больших объемов данных с целью получения простых и полезных для бизнеса результатов - это один из главных новых трендов ИТ рынка. А сервис 1С-Битрикс BigData - это пожалуй, первый отечественный сервис, основанный на этой технологии. Первым применением этого искусственного интеллекта станет оптимизация (персонализация) интернет-магазинов на движке Битрикс под каждого нового посетителя. На основе анализа большого количества данных о всех прошлых посетителях, сервис сможет предсказывать поведение

нового посетителя на сайте, выделять похожих на него клиентов, и делать ему

персонализированные предложения на основе истории покупок других

клиентов. Вероятно, скоро можно будет ожидать Big Data функции и в системе управления бизнесом Битрикс24.

2014. SAP: Сборная Германии выиграла Чемпионат Мира благодаря Big Data

Недавно, в прошлом году, яхта Oracle выиграла Кубок Америки, и тогда в Oracle сказали , что эта победа произошла во многом благодаря системе анализа больших данных (Big Data) в облаке Oracle. Теперь настало время извечного конкурента Oracle - немецкой компании SAP ответить на этот PR-ход. Оказалось, что сборная Германии выиграла Чемпионат Мира по футболу тоже благодаря Big Data. В SAP разработали систему Match Insights , которая считывает футбольный матч в 3-х мерную цифровую модель и анализирует действия каждого игрока и команды в целом. Анализировались не только матчи собственной сборной (чтобы исправить ошибки и улучшить эффективность), но и матчи конкурентов. Искусственный интеллект находил слабые места соперников и помогал команде подготовиться к матчу. А мораль этой басни такова: Представьте, что Big Data может сделать для вашего бизнеса.

2014. КРОК запустил облачное решение класса Business Intelligence

Системный интегратор Крок запустил сервис бизнес-аналитики с говорящим названием "Business Intelligence as a Service" или BIaaS. Решение рассчитано на крупные организации, заинтересованные в снижении капитальных затрат и ускорении принятия управленческих решений. Система построена на продукте EMC Greenplum и представляет собой решение уровня Big Data. С помощью этого инструмента можно анализировать и сравнивать большие объемы информации, выстраивать ключевые показатели и принимать бизнес-решения, минуя стадию капитальных затрат на приобретение софта, лицензий и возможную модернизацию инфраструктуры. Решение позволяет реализовать три возможных сценария работы с данными - аналитика для ритейла, анализ показателей работы контакт-центра, а также оценка управленческой деятельности организации на соответствие KPI.

2013. SAP делает большие бизнесы эффективными с помощью Big Data. Конкуренты плачут

В последние годы SAP проявлял себя, как наименее инновационная ИТ компания (по сравнению с конкурентами Oracle, Microsoft, IBM). Все собственные инновационные проекты SAP в основном проваливались (вспомните ), и единственное, что получалось у SAP - это покупать другие компании (SuccessFactors, SyBase, Ariba). Но на этот раз SAP, похоже, решил утереть нос конкурентам. И сделает он это за счет новой модной технологии Big Data. Что это такое?

Предсказывалось, что общий мировой объем созданных и реплицированных данных в 2011-м может составить около 1,8 зеттабайта (1,8 трлн. гигабайт) - примерно в 9 раз больше того, что было создано в 2006-м.

Более сложное определение

Тем не менее `большие данные ` предполагают нечто большее, чем просто анализ огромных объемов информации. Проблема не в том, что организации создают огромные объемы данных, а в том, что бóльшая их часть представлена в формате, плохо соответствующем традиционному структурированному формату БД, - это веб-журналы, видеозаписи, текстовые документы, машинный код или, например, геопространственные данные. Всё это хранится во множестве разнообразных хранилищ, иногда даже за пределами организации. В результате корпорации могут иметь доступ к огромному объему своих данных и не иметь необходимых инструментов, чтобы установить взаимосвязи между этими данными и сделать на их основе значимые выводы. Добавьте сюда то обстоятельство, что данные сейчас обновляются все чаще и чаще, и вы получите ситуацию, в которой традиционные методы анализа информации не могут угнаться за огромными объемами постоянно обновляемых данных, что в итоге и открывает дорогу технологиям больших данных .

Наилучшее определение

В сущности понятие больших данных подразумевает работу с информацией огромного объема и разнообразного состава, весьма часто обновляемой и находящейся в разных источниках в целях увеличения эффективности работы, создания новых продуктов и повышения конкурентоспособности. Консалтинговая компания Forrester дает краткую формулировку: `Большие данные объединяют техники и технологии, которые извлекают смысл из данных на экстремальном пределе практичности`.

Насколько велика разница между бизнес-аналитикой и большими данными?

Крейг Бати, исполнительный директор по маркетингу и директор по технологиям Fujitsu Australia, указывал, что бизнес-анализ является описательным процессом анализа результатов, достигнутых бизнесом в определенный период времени, между тем как скорость обработки больших данных позволяет сделать анализ предсказательным, способным предлагать бизнесу рекомендации на будущее. Технологии больших данных позволяют также анализировать больше типов данных в сравнении с инструментами бизнес-аналитики, что дает возможность фокусироваться не только на структурированных хранилищах.

Мэтт Слокум из O"Reilly Radar считает, что хотя большие данные и бизнес-аналитика имеют одинаковую цель (поиск ответов на вопрос), они отличаются друг от друга по трем аспектам.

- Большие данные предназначены для обработки более значительных объемов информации, чем бизнес-аналитика, и это, конечно, соответствует традиционному определению больших данных.

- Большие данные предназначены для обработки более быстро получаемых и меняющихся сведений, что означает глубокое исследование и интерактивность. В некоторых случаях результаты формируются быстрее, чем загружается веб-страница.

- Большие данные предназначены для обработки неструктурированных данных, способы использования которых мы только начинаем изучать после того, как смогли наладить их сбор и хранение, и нам требуются алгоритмы и возможность диалога для облегчения поиска тенденций, содержащихся внутри этих массивов.

Согласно опубликованной компанией Oracle белой книге `Информационная архитектура Oracle: руководство архитектора по большим данным` (Oracle Information Architecture: An Architect"s Guide to Big Data), при работе с большими данными мы подходим к информации иначе, чем при проведении бизнес-анализа.

Работа с большими данными не похожа на обычный процесс бизнес-аналитики, где простое сложение известных значений приносит результат: например, итог сложения данных об оплаченных счетах становится объемом продаж за год. При работе с большими данными результат получается в процессе их очистки путём последовательного моделирования: сначала выдвигается гипотеза, строится статистическая, визуальная или семантическая модель, на ее основании проверяется верность выдвинутой гипотезы и затем выдвигается следующая. Этот процесс требует от исследователя либо интерпретации визуальных значений или составления интерактивных запросов на основе знаний, либо разработки адаптивных алгоритмов `машинного обучения `, способных получить искомый результат. Причём время жизни такого алгоритма может быть довольно коротким.

Методики анализа больших данных

Существует множество разнообразных методик анализа массивов данных, в основе которых лежит инструментарий, заимствованный из статистики и информатики (например, машинное обучение). Список не претендует на полноту, однако в нем отражены наиболее востребованные в различных отраслях подходы. При этом следует понимать, что исследователи продолжают работать над созданием новых методик и совершенствованием существующих. Кроме того, некоторые из перечисленных них методик вовсе не обязательно применимы исключительно к большим данным и могут с успехом использоваться для меньших по объему массивов (например, A/B-тестирование, регрессионный анализ). Безусловно, чем более объемный и диверсифицируемый массив подвергается анализу, тем более точные и релевантные данные удается получить на выходе.

A/B testing . Методика, в которой контрольная выборка поочередно сравнивается с другими. Тем самым удается выявить оптимальную комбинацию показателей для достижения, например, наилучшей ответной реакции потребителей на маркетинговое предложение. Большие данные позволяют провести огромное количество итераций и таким образом получить статистически достоверный результат.

Association rule learning . Набор методик для выявления взаимосвязей, т.е. ассоциативных правил, между переменными величинами в больших массивах данных. Используется в data mining .

Classification . Набор методик, которые позволяет предсказать поведение потребителей в определенном сегменте рынка (принятие решений о покупке, отток, объем потребления и проч.). Используется в data mining .

Cluster analysis . Статистический метод классификации объектов по группам за счет выявления наперед не известных общих признаков. Используется в data mining .

Crowdsourcing . Методика сбора данных из большого количества источников.

Data fusion and data integration . Набор методик, который позволяет анализировать комментарии пользователей социальных сетей и сопоставлять с результатами продаж в режиме реального времени.

Data mining . Набор методик, который позволяет определить наиболее восприимчивые для продвигаемого продукта или услуги категории потребителей, выявить особенности наиболее успешных работников, предсказать поведенческую модель потребителей.

Ensemble learning . В этом методе задействуется множество предикативных моделей за счет чего повышается качество сделанных прогнозов.

Genetic algorithms . В этой методике возможные решения представляют в виде `хромосом`, которые могут комбинироваться и мутировать. Как и в процессе естественной эволюции, выживает наиболее приспособленная особь.

Machine learning . Направление в информатике (исторически за ним закрепилось название `искусственный интеллект`), которое преследует цель создания алгоритмов самообучения на основе анализа эмпирических данных.

Natural language processing (NLP ). Набор заимствованных из информатики и лингвистики методик распознавания естественного языка человека.

Network analysis . Набор методик анализа связей между узлами в сетях. Применительно к социальным сетям позволяет анализировать взаимосвязи между отдельными пользователями, компаниями, сообществами и т.п.

Optimization . Набор численных методов для редизайна сложных систем и процессов для улучшения одного или нескольких показателей. Помогает в принятии стратегических решений, например, состава выводимой на рынок продуктовой линейки, проведении инвестиционного анализа и проч.

Pattern recognition . Набор методик с элементами самообучения для предсказания поведенческой модели потребителей.

Predictive modeling . Набор методик, которые позволяют создать математическую модель наперед заданного вероятного сценария развития событий. Например, анализ базы данных CRM -системы на предмет возможных условий, которые подтолкнут абоненты сменить провайдера.

Regression . Набор статистических методов для выявления закономерности между изменением зависимой переменной и одной или несколькими независимыми. Часто применяется для прогнозирования и предсказаний. Используется в data mining.

Sentiment analysis . В основе методик оценки настроений потребителей лежат технологии распознавания естественного языка человека. Они позволяют вычленить из общего информационного потока сообщения, связанные с интересующим предметом (например, потребительским продуктом). Далее оценить полярность суждения (позитивное или негативное), степень эмоциональности и проч.

Signal processing . Заимствованный из радиотехники набор методик, который преследует цель распознавания сигнала на фоне шума и его дальнейшего анализа.

Spatial analysis . Набор отчасти заимствованных из статистики методик анализа пространственных данных – топологии местности, географических координат, геометрии объектов. Источником больших данных в этом случае часто выступают геоинформационные системы (ГИС).

Statistics . Наука о сборе, организации и интерпретации данных, включая разработку опросников и проведение экспериментов. Статистические методы часто применяются для оценочных суждений о взаимосвязях между теми или иными событиями.

Supervised learning . Набор основанных на технологиях машинного обучения методик, которые позволяют выявить функциональные взаимосвязи в анализируемых массивах данных.

Simulation . Моделирование поведения сложных систем часто используется для прогнозирования, предсказания и проработки различных сценариев при планировании.

Time series analysis . Набор заимствованных из статистики и цифровой обработки сигналов методов анализа повторяющихся с течением времени последовательностей данных. Одни из очевидных применений – отслеживание рынка ценных бумаг или заболеваемости пациентов.

Unsupervised learning . Набор основанных на технологиях машинного обучения методик, которые позволяют выявить скрытые функциональные взаимосвязи в анализируемых массивах данных. Имеет общие черты с Cluster Analysis .

Визуализация . Методы графического представления результатов анализа больших данных в виде диаграмм или анимированных изображений для упрощения интерпретации облегчения понимания полученных результатов.

Наглядное представление результатов анализа больших данных имеет принципиальное значение для их интерпретации. Не секрет, что восприятие человека ограничено, и ученые продолжают вести исследования в области совершенствования современных методов представления данных в виде изображений, диаграмм или анимаций.

Аналитический инструментарий

На 2011 год некоторые из перечисленных в предыдущем подразделе подходов или определенную их совокупность позволяют реализовать на практике аналитические движки для работы с большими данными. Из свободных или относительно недорогих открытых систем анализа Big Data можно порекомендовать:

- Revolution Analytics (на базе языка R для мат.статистики).

Особый интерес в этом списке представляет Apache Hadoop – ПО с открытым кодом, которое за последние пять лет испытано в качестве анализатора данных большинством трекеров акций . Как только Yahoo открыла код Hadoop сообществу с открытым кодом, в ИТ-индустрии незамедлительно появилось целое направление по созданию продуктов на базе Hadoop. Практически все современные средства анализа больших данных предоставляют средства интеграции с Hadoop. Их разработчиками выступают как стартапы, так и общеизвестные мировые компании.

Рынки решений для управления большими данными

Платформы больших данных (BDP, Big Data Platform) как средство борьбы с цифровым хордингом

Возможность анализировать большие данные , в просторечии называемая Big Data, воспринимается как благо, причем однозначно. Но так ли это на самом деле? К чему может привести безудержное накопление данных? Скорее всего к тому, что отечественные психологи применительно к человеку называют патологическим накопительством, силлогоманией или образно "синдромом Плюшкина". По-английски порочная страсть собирать все подряд называют хордингом (от англ. hoard – «запас»). По классификации ментальных заболеваний хординг причислен к психическим расстройствам. В цифровую эпоху к традиционному вещественному хордингу добавляется цифровой (Digital Hoarding), им могут страдать как отдельные личности, так и целые предприятия и организации ().

Мировой и рынок России

Big data Landscape - Основные поставщики

Интерес к инструментам сбора, обработки, управления и анализа больших данных проявляли едва ли не все ведущие ИТ-компании, что вполне закономерно. Во-первых, они непосредственно сталкиваются с этим феноменом в собственном бизнесе, во-вторых, большие данные открывают отличные возможности для освоения новых ниш рынка и привлечения новых заказчиков.

На рынке появлялось множество стартапов, которые делают бизнес на обработке огромных массивов данных. Часть из них используют готовую облачную инфраструктуру, предоставляемую крупными игроками вроде Amazon.

Теория и практика Больших данных в отраслях

История развития

2017

Прогноз TmaxSoft: следующая «волна» Big Data потребует модернизации СУБД

Предприятиям известно, что в накопленных ими огромных объемах данных содержится важная информация об их бизнесе и клиентах. Если компания сможет успешно применить эту информацию, то у нее будет значительное преимущество по сравнению с конкурентами, и она сможет предложить лучшие, чем у них, продукты и сервисы. Однако многие организации всё еще не могут эффективно использовать большие данные из-за того, что их унаследованная ИТ-инфраструктура неспособна обеспечить необходимую емкость систем хранения, процессы обмена данных, утилиты и приложения, необходимые для обработки и анализа больших массивов неструктурированных данных для извлечения из них ценной информации, указали в TmaxSoft.

Кроме того, увеличение процессорной мощности, необходимой для анализа постоянно увеличивающихся объемов данных, может потребовать значительных инвестиций в устаревшую ИТ-инфраструктуру организации, а также дополнительных ресурсов для сопровождения, которые можно было бы использовать для разработки новых приложений и сервисов.

5 февраля 2015 года Белый дом опубликовал доклад , в котором обсуждался вопрос о том, как компании используют «большие данные » для установления различных цен для разных покупателей - практика, известная как «ценовая дискриминация» или «дифференцированное ценообразование» (personalized pricing). Отчет описывает пользу «больших данных» как для продавцов, так и покупателей, и его авторы приходят к выводу о том, что многие проблемные вопросы, возникшие в связи с появлением больших данных и дифференцированного ценообразования, могут быть решены в рамках существующего антидискриминационного законодательства и законов, защищающих права потребителей.

В докладе отмечается, что в это время имеются лишь отдельные факты, свидетельствующие о том, как компании используют большие данные в контексте индивидуализированного маркетинга и дифференцированного ценообразования. Этот сведения показывают, что продавцы используют методы ценообразования, которые можно разделить на три категории:

- изучение кривой спроса;

- Наведение (steering) и дифференцированное ценообразование на основе демографических данных; и

- целевой поведенческий маркетинг (поведенческий таргетинг - behavioral targeting) и индивидуализированное ценообразование.

Изучение кривой спроса : С целью выяснения спроса и изучения поведения потребителей маркетологи часто проводят эксперименты в этой области, в ходе которых клиентам случайным образом назначается одна из двух возможных ценовых категорий. «Технически эти эксперименты являются формой дифференцированного ценообразования, поскольку их следствием становятся разные цены для клиентов, даже если они являются «недискриминационными» в том смысле, что у всех клиенты вероятность «попасть» на более высокую цену одинакова».

Наведение (steering) : Это практика представления продуктов потребителям на основе их принадлежности к определенной демографической группе. Так, веб-сайт компьютерной компании может предлагать один и тот же ноутбук различным типам покупателей по разным ценам, уставленным на основе сообщённой ими о себе информации (например, в зависимости от того, является ли данный пользователь представителем государственных органов, научных или коммерческих учреждений, или же частным лицом) или от их географического расположения (например, определенного по IP-адресу компьютера).

Целевой поведенческий маркетинг и индивидуализированное ценообразование : В этих случаях персональные данные покупателей используются для целевой рекламы и индивидуализированного назначения цен на определенные продукты. Например, онлайн-рекламодатели используют собранные рекламными сетями и через куки третьих сторон данные об активности пользователей в интернете для того, чтобы нацелено рассылать свои рекламные материалы. Такой подход, с одной стороны, дает возможность потребителям получить рекламу представляющих для них интерес товаров и услуг, Он, однако, может вызвать озабоченность тех потребителей, которые не хотят, чтобы определенные виды их персональных данных (такие, как сведения о посещении сайтов, связанных с медицинскими и финансовыми вопросами) собирались без их согласия.

Хотя целевой поведенческий маркетинг широко распространен, имеется относительно мало свидетельств индивидуализированного ценообразования в онлайн-среде. В отчете высказывается предположение, что это может быть связано с тем, что соответствующие методы все ещё разрабатываются, или же с тем, что компании не спешат использовать индивидуальное ценообразование (либо предпочитают о нём помалкивать) - возможно, опасаясь негативной реакции со стороны потребителей.

Авторы отчета полагают, что «для индивидуального потребителя использование больших данных, несомненно, связано как с потенциальной отдачей, так и с рисками». Признавая, что при использовании больших данных появляются проблемы прозрачности и дискриминации, отчет в то же время утверждает, что существующих антидискриминационных законов и законов по защиты прав потребителей достаточно для их решения. Однако в отчете также подчеркивается необходимость «постоянного контроля» в тех случаях, когда компании используют конфиденциальную информацию непрозрачным образом либо способами, которые не охватываются существующей нормативно-правовой базой.

Данный доклад является продолжением усилий Белого дома по изучению применения «больших данных» и дискриминационного ценообразования в Интернете, и соответствующих последствий для американских потребителей. Ранее уже сообщалось о том, что рабочая группа Белого дома по большим данным опубликовала в мае 2014 года свой доклад по этому вопросу. Федеральная комиссия по торговле (FTC) также рассматривала эти вопросы в ходе проведенного ею в сентября 2014 года семинара по дискриминации в связи с использованием больших данных .

2014

Gartner развеивает мифы о "Больших данных"

В аналитической записке осени 2014 года Gartner перечислен ряд распространенных среди ИТ-руководителей мифов относительно Больших Данных и приводятся их опровержения.

- Все внедряют системы обработки Больших Данных быстрее нас

Интерес к технологиям Больших Данных рекордно высок: в 73% организаций, опрошенных аналитиками Gartner в этом году, уже инвестируют в соответствующие проекты или собираются. Но большинство таких инициатив пока еще на самых ранних стадиях, и только 13% опрошенных уже внедрили подобные решения. Сложнее всего - определить, как извлекать доход из Больших Данных, решить, с чего начать. Во многих организациях застревают на пилотной стадии, поскольку не могут привязать новую технологию к конкретным бизнес-процессам.

- У нас так много данных, что нет нужды беспокоиться о мелких ошибках в них

Некоторые ИТ-руководители считают, что мелкие огрехи в данных не влияют на общие результаты анализа огромных объемов. Когда данных много, каждая ошибка в отдельности действительно меньше влияет на результат, отмечают аналитики, но и самих ошибок становится больше. Кроме того, большая часть анализируемых данных - внешние, неизвестной структуры или происхождения, поэтому вероятность ошибок растет. Таким образом, в мире Больших Данных качество на самом деле гораздо важнее.

- Технологии Больших Данных отменят нужду в интеграции данных

Большие Данные обещают возможность обработки данных в оригинальном формате с автоматическим формированием схемы по мере считывания. Считается, что это позволит анализировать информацию из одних и тех же источников с помощью нескольких моделей данных. Многие полагают, что это также даст возможность конечным пользователям самим интерпретировать любой набор данных по своему усмотрению. В реальности большинству пользователей часто нужен традиционный способ с готовой схемой, когда данные форматируются соответствующим образом, и имеются соглашения об уровне целостности информации и о том, как она должна соотноситься со сценарием использования.

- Хранилища данных нет смысла использовать для сложной аналитики

Многие администраторы систем управления информацией считают, что нет смысла тратить время на создание хранилища данных, принимая во внимание, что сложные аналитические системы пользуются новыми типами данных. На самом деле во многих системах сложной аналитики используется информация из хранилища данных. В других случаях новые типы данных нужно дополнительно готовить к анализу в системах обработки Больших Данных; приходится принимать решения о пригодности данных, принципах агрегации и необходимом уровне качества - такая подготовка может происходить вне хранилища.

- На смену хранилищам данных придут озера данных

В реальности поставщики вводят заказчиков в заблуждение, позиционируя озера данных (data lake) как замену хранилищам или как критически важные элементы аналитической инфраструктуры. Основополагающим технологиям озер данных не хватает зрелости и широты функциональности, присущей хранилищам. Поэтому руководителям, отвечающим за управление данными, стоит подождать, пока озера достигнут того же уровня развития, считают в Gartner.

Accenture: 92% внедривших системы больших данных, довольны результатом

Среди главных преимуществ больших данных опрошенные назвали:

- «поиск новых источников дохода» (56%),

- «улучшение опыта клиентов» (51%),

- «новые продукты и услуги» (50%) и

- «приток новых клиентов и сохранение лояльности старых» (47%).

При внедрении новых технологий многие компании столкнулись с традиционными проблемами. Для 51% камнем преткновения стала безопасность, для 47% - бюджет, для 41% - нехватка необходимых кадров, а для 35% - сложности при интеграции с существующей системой. Практически все опрошенные компании (около 91%) планируют в скором времени решать проблему с нехваткой кадров и нанимать специалистов по большим данным.

Компании оптимистично оценивают будущее технологий больших данных. 89% считают, что они изменят бизнес столь же сильно, как и интернет. 79% респондентов отметили, что компании, которые не занимаются большими данными, потеряют конкурентное преимущество.

Впрочем, опрошенные разошлись во мнении о том, что именно стоит считать большими данными. 65% респондентов считают, что это «большие картотеки данных», 60% уверены, что это «продвинутая аналитика и анализ», а 50% - что это «данные инструментов визуализации».

Мадрид тратит 14,7 млн евро на управление большими данными

В июле 2014 г. стало известно о том, что Мадрид будет использовать технологии big data для управления городской инфраструктурой. Стоимость проекта - 14,7 млн евро, основу внедряемых решений составят технологии для анализа и управления большими данными. С их помощью городская администрация будет управлять работой с каждым сервис-провайдером и соответствующим образом оплачивать ее в зависимости от уровня услуг.

Речь идет о подрядчиках администрации, которые следят за состоянием улиц, освещением, ирригацией, зелеными насаждениями, осуществляют уборку территории и вывоз, а также переработку мусора. В ходе проекта для специально выделенных инспекторов разработаны 300 ключевых показателей эффективности работы городских сервисов, на базе которых ежедневно будет осуществляться 1,5 тыс. различных проверок и замеров. Кроме того, город начнет использование инновационной технологическлй платформы под названием Madrid iNTeligente (MiNT) - Smarter Madrid.

2013

Эксперты: Пик моды на Big Data

Все без исключения вендоры на рынке управления данными в это время ведут разработку технологий для менеджмента Big Data. Этот новый технологический тренд также активно обсуждается профессиональными сообществом, как разработчиками, так и отраслевыми аналитиками и потенциальными потребителями таких решений.

Как выяснила компания Datashift, по состоянию на январь 2013 года волна обсуждений вокруг «больших данных » превысила все мыслимые размеры. Проанализировав число упоминаний Big Data в социальных сетях, в Datashift подсчитали, что за 2012 год этот термин употреблялся около 2 млрд раз в постах, созданных около 1 млн различных авторов по всему миру. Это эквивалентно 260 постам в час, причем пик упоминаний составил 3070 упоминаний в час.

Gartner: Каждый второй ИТ-директор готов потратиться на Big data

После нескольких лет экспериментов с технологиями Big data и первых внедрений в 2013 году адаптация подобных решений значительно возрастет, прогнозируют в Gartner . Исследователи опросили ИТ-лидеров во всем мире и установили, что 42% опрошенных уже инвестировали в технологии Big data или планируют совершить такие инвестиции в течение ближайшего года (данные на март 2013 года).

Компании вынуждены потратиться на технологии обработки больших данных , поскольку информационный ландшафт стремительно меняется, требую новых подходов к обработки информации. Многие компании уже осознали, что большие массивы данных являются критически важными, причем работа с ними позволяет достичь выгод, не доступных при использовании традиционных источников информации и способов ее обработки. Кроме того, постоянное муссирование темы «больших данных» в СМИ подогревает интерес к соответствующим технологиям.

Фрэнк Байтендидк (Frank Buytendijk), вице-президент Gartner, даже призвал компании умерить пыл, поскольку некоторые проявляют беспокойство, что отстают от конкурентов в освоении Big data.

«Волноваться не стоит, возможности для реализации идей на базе технологий «больших данных» фактически безграничны», - заявил он.

По прогнозам Gartner, к 2015 году 20% компаний списка Global 1000 возьмут стратегический фокус на «информационную инфраструктуру».

В ожидании новых возможностей, которые принесут с собой технологии обработки «больших данных», уже сейчас многие организации организуют процесс сбора и хранения различного рода информации.

Для образовательных и правительственных организаций, а также компаний отрасли промышленности наибольший потенциал для трансформации бизнеса заложен в сочетании накопленных данных с так называемыми dark data (дословно – «темными данными»), к последним относятся сообщения электронной почты, мультимедиа и другой подобный контент. По мнению Gartner, в гонке данных победят именно те, кто научится обращаться с самыми разными источниками информации.

Опрос Cisco: Big Data поможет увеличить ИТ-бюджеты

В ходе исследования (весна 2013 года) под названием Cisco Connected World Technology Report, проведенного в 18 странах независимой аналитической компанией InsightExpress, были опрошены 1 800 студентов колледжей и такое же количество молодых специалистов в возрасте от 18 до 30 лет. Опрос проводился, чтобы выяснить уровень готовности ИТ-отделов к реализации проектов Big Data и получить представление о связанных с этим проблемах, технологических изъянах и стратегической ценности таких проектов.

Большинство компаний собирает, записывает и анализирует данные. Тем не менее, говорится в отчете, многие компании в связи с Big Data сталкиваются с целым рядом сложных деловых и информационно-технологических проблем. К примеру, 60 процентов опрошенных признают, что решения Big Data могут усовершенствовать процессы принятия решений и повысить конкурентоспособность, но лишь 28 процентов заявили о том, что уже получают реальные стратегические преимущества от накопленной информации.

Более половины опрошенных ИТ-руководителей считают, что проекты Big Data помогут увеличить ИТ-бюджеты в их организациях, так как будут предъявляться повышенные требования к технологиям, персоналу и профессиональным навыкам. При этом более половины респондентов ожидают, что такие проекты увеличат ИТ-бюджеты в их компаниях уже в 2012 году. 57 процентов уверены в том, что Big Data увеличит их бюджеты в течение следующих трех лет.

81 процент респондентов заявили, что все (или, по крайней мере, некоторые) проекты Big Data потребуют применения облачных вычислений. Таким образом, распространение облачных технологий может сказаться на скорости распространения решений Big Data и на ценности этих решений для бизнеса.

Компании собирают и используют данные самых разных типов, как структурированные, так и неструктурированные. Вот из каких источников получают данные участники опроса (Cisco Connected World Technology Report):

Почти половина (48 процентов) ИТ-руководителей прогнозирует удвоение нагрузки на их сети в течение ближайших двух лет. (Это особенно характерно для Китая , где такой точки зрения придерживаются 68 процентов опрошенных, и Германии – 60 процентов). 23 процента респондентов ожидают утроения сетевой нагрузки на протяжении следующих двух лет. При этом лишь 40 процентов респондентов заявили о своей готовности к взрывообразному росту объемов сетевого трафика.

27 процентов опрошенных признали, что им необходимы более качественные ИТ-политики и меры информационной безопасности .

21 процент нуждается в расширении полосы пропускания.

Big Data открывает перед ИТ-отделами новые возможности для наращивания ценности и формирования тесных отношений с бизнес-подразделениями, позволяя повысить доходы и укрепить финансовое положение компании. Проекты Big Data делают ИТ-подразделения стратегическим партнером бизнес-подразделений.

По мнению 73 процентов респондентов, именно ИТ-отдел станет основным локомотивом реализации стратегии Big Data. При этом, считают опрошенные, другие отделы тоже будут подключаться к реализации этой стратегии. Прежде всего, это касается отделов финансов (его назвали 24 процента респондентов), научно-исследовательского (20 процентов), операционного (20 процентов), инженерного (19 процентов), а также отделов маркетинга (15 процентов) и продаж (14 процентов).

Gartner: Для управления большими данными нужны миллионы новых рабочих мест

Мировые ИТ расходы достигнут $3,7 млрд к 2013 году, что на 3,8% больше расходов на информационные технологии в 2012 году (прогноз на конец года составляет $3,6 млрд). Сегмент больших данных (big data) будет развиваться гораздо более высокими темпами, говорится в отчете Gartner .

К 2015 году 4,4 млн рабочих мест в сфере информационных технологий будет создано для обслуживания больших данных, из них 1,9 млн рабочих мест – в . Более того, каждое такое рабочее место повлечет за собой создание трех дополнительных рабочих мест за пределами сферы ИТ, так что только в США в ближайшие четыре года 6 млн человек будет трудиться для поддержания информационной экономики.

По мнению экспертов Gartner, главная проблема состоит в том, что в отрасли для этого недостаточно талантов: как частная, так и государственная образовательная система, например, в США не способны снабжать отрасль достаточным количеством квалифицированных кадров. Так что из упомянутых новых рабочих мест в ИТ кадрами будет обеспечено только одно из трех.

Аналитики полагают, что роль взращивания квалифицированных ИТ кадров должны брать на себя непосредственно компании, которые в них остро нуждаются, так как такие сотрудники станут пропуском для них в новую информационную экономику будущего.

2012

Первый скепсис в отношении "Больших данных"

Аналитики компаний Ovum и Gartner предполагают, что для модной в 2012 году темы больших данных может настать время освобождения от иллюзий.

Термином «Большие Данные», в это время как правило, обозначают постоянно растущий объем информации, поступающей в оперативном режиме из социальных медиа, от сетей датчиков и других источников, а также растущий диапазон инструментов, используемых для обработки данных и выявления на их основе важных бизнес-тенденций.

«Из-за шумихи (или несмотря на нее) относительно идеи больших данных производители в 2012 году с огромной надеждой смотрели на эту тенденцию», - отметил Тони Байер, аналитик Ovum.

Байер сообщил, что компания DataSift провела ретроспективный анализ упоминаний больших данных в

Что такое Big Data (дословно — большие данные )? Обратимся сначала к оксфордскому словарю:

Данные — величины, знаки или символы, которыми оперирует компьютер и которые могут храниться и передаваться в форме электрических сигналов, записываться на магнитные, оптические или механические носители.

Термин Big Data используется для описания большого и растущего экспоненциально со временем набора данных. Для обработки такого количества данных не обойтись без .

Преимущества, которые предоставляет Big Data:

- Сбор данных из разных источников.

- Улучшение бизнес-процессов через аналитику в реальном времени.

- Хранение огромного объема данных.

- Инсайты. Big Data более проницательна к скрытой информации при помощи структурированных и полуструктурированных данных.

- Большие данные помогают уменьшать риск и принимать умные решения благодаря подходящей риск-аналитике

Примеры Big Data

Нью-Йоркская Фондовая Биржа ежедневно генерирует 1 терабайт данных о торгах за прошедшую сессию.

Социальные медиа : статистика показывает, что в базы данных Facebook ежедневно загружается 500 терабайт новых данных, генерируются в основном из-за загрузок фото и видео на серверы социальной сети, обмена сообщениями, комментариями под постами и так далее.

Реактивный двигатель генерирует 10 терабайт данных каждые 30 минут во время полета. Так как ежедневно совершаются тысячи перелетов, то объем данных достигает петабайты.

Классификация Big Data

Формы больших данных:

- Структурированная

- Неструктурированная

- Полуструктурированная

Структурированная форма

Данные, которые могут храниться, быть доступными и обработанными в форме с фиксированным форматом называются структурированными. За продолжительное время компьютерные науки достигли больших успехов в совершенствовании техник для работы с этим типом данных (где формат известен заранее) и научились извлекать пользу. Однако уже сегодня наблюдаются проблемы, связанные с ростом объемов до размеров, измеряемых в диапазоне нескольких зеттабайтов.

1 зеттабайт соответствует миллиарду терабайт

Глядя на эти числа, нетрудно убедиться в правдивости термина Big Data и трудностях сопряженных с обработкой и хранением таких данных.

Данные, хранящиеся в реляционной базе — структурированы и имеют вид,например, таблицы сотрудников компании

Неструктурированная форма